1.1. Эволюционная и кибернетическая метафоры

Пытаясь разобраться в функционировании мозга и поведении, мы постоянно пользуемся двумя метафорами.

Первая метафора - "человек - это животное" - нацеливает нас на эволюционные и сравнительные исследования поведения животных и функционирования мозга. Более ста лет назад Дарвин убедил нас в том, что люди - это биологические организмы, возникшие в результате эволюции от общих с другими организмами предков. И в силу этой общности предков мы полагаем, что в устройстве нашего мозга и мозга других животных есть нечто общее. Из данных, собранных во время операций на мозге людей, мы можем извлечь лишь отрывочные сведения о деятельности человеческого мозга, а в экспериментах на животных мы можем практически не ограничивать себя, позаботившись лишь о том, чтобы не причинять животным излишних страданий. Мы надеемся получить массу сведений а функционировании мозга человека, раздражая мозг животных и регистрируя его активность или удаляя определенные его участки и наблюдая происходящие при этом изменения в поведении, а затем сопоставляя полученные результаты с последствиями удаления определенных участков головного мозга у человека - операций, к которым приходится иногда прибегать при эпилепсии или при опухолях мозга. Таким путем мы надеемся выяснить вклад разных частей мозга (как порознь, так и в различных сочетаниях) в столь разнообразные аспекты его деятельности, как регуляция движений, восприятие и обучение.

Мы не утверждаем при этом, что человек ничем не отличается от других животных. Мы надеемся приобрести знания с позиций метафоры "человек - это животное", изучая как черты сходства между человеком и животными, так и различия между ними. Например, нам известно, что человек гораздо более ловко использует орудия, чем любое другое животное, и что человеческий язык намного превосходит системы общения всех других видов. Нам известно также, что мозг человека кое в чем отличается от мозга животных. Пытаясь выявить корреляции между уникальностью поведения человека и его биологической универсальностью, мы можем надеяться узнать нечто новое о функционировании мозга, и это дает нам не меньше, чем перенесение результатов, полученных при изучении механизмов функционирования мозга животных, на человеческий мозг.

Переходя к нашей второй метафоре - "человек - это машина" - и стараясь использовать черты сходства между человеком и машиной, например пытаясь увидеть различные аспекты человеческого поведения у робота, мы по-прежнему должны все время помнить о том, что поведение человека, его память, восприятие и способность к обучению гораздо богаче, чем у автомата, как уже существующего, так и любого из тех, которые мы можем надеяться создать в ближайшем будущем. Поэтому, когда мы говорим, что в некоторых отношениях человеческий мозг можно рассматривать как вычислительную машину с заложенной в нее программой, мы не низводим человека до уровня существующих механизмов, а просто стараемся понять, как вычислительные машины могут помочь нам разобраться в особенностях поведения человека. Исследования такого рода мы будем называть кибернетическими, вкладывая в этот термин более широкий смысл, чем это делал Винер [256], определивший кибернетику как "изучение процессов управления и связи в человеке и машине". Здесь мы примем, что человек, работающий в области кибернетики, попытается сконструировать, по крайней мере в принципе, сложную систему переработки информации, способную выполнять некоторые интеллектуальные функции, аналогичные функциям мозга человека.

С нашей второй метафорой нужно обращаться очень осторожно, ибо мы собираемся пользоваться ею в двух совершенно разных смыслах. В первом случае (во второй части книги) мы подходим к ней с позиций теории искусственного интеллекта и нас просто интересует, как составить программу для существующей вычислительной машины, с тем, чтобы получить "разумное" поведение; при этом мы не делаем никаких попыток установить корреляцию между структурой программы и строением мозга. Здесь мы покажем, что идея программы, хранящейся в запоминающем устройстве, более плодотворна, чем прежний подход к изучению поведения, основанный на исследовании взаимоотношений "стимул - реакция", и что удивительно сложное поведение можно иногда разложить во взаимосвязанную последовательность относительно простых актов.

Второе толкование метафоры "человек - это машина", которому посвящена третья часть книги и которое мы назовем подходом с позиций теории мозга, выдвигает на первый план создание машин, структура которых в известном смысле аналогична структуре мозга. В нашей версии этого последнего подхода основное внимание уделяется вопросам "распределенных деенаправленных вычислений в многослойных соматотопически организованных машинах" (эта туманная терминология разъясняется в третьей части, а здесь читателю достаточно запомнить, что эта фраза будет ключевой для всей нашей теории мозга), и мы будем широко пользоваться результатами сравнительных исследований (метафора "человек - это животное") в надежде понять, какой должна быть структура создаваемых нами моделей. В то время как большинство работ по искусственному интеллекту предполагает выполнение определенной последовательности простых операций над пассивно накопленными данными, наша теория мозга концентрирует внимание на параллельном выполнении сразу большого числа операций над целыми комплексами взаимодействующих данных, поступающих в те контуры управления, которые вовлечены в действие.

Проводя грань между искусственным интеллектом и теорией мозга, следует остерегаться ошибки, часто встречающейся в литературе по психологии и состоящей в утверждении, что каждому процессу, происходящему в мозге, соответствует своя область головного мозга и наоборот. Для психолога это может быть несущественно, но для исследователя эволюции мозга или для нейрохирурга, приступающего к операции, физическая локализация данной функции в мозге имеет решающее значение. Если анализ системы S показал, что ее поведение эквивалентно поведению двух взаимосвязанных систем S1 и S2, каждая из которых обладает строго определенными функциями, и нам кажется, что в результате такой декомпозиции в поведении исходной системы многое стало понятным, отсюда вовсе не следует, что существует способ пространственного разделения S на две системы, каждая из которых эквивалентна и S2 соответственно. Поясним это на простом примере, который мы подробно проанализируем.

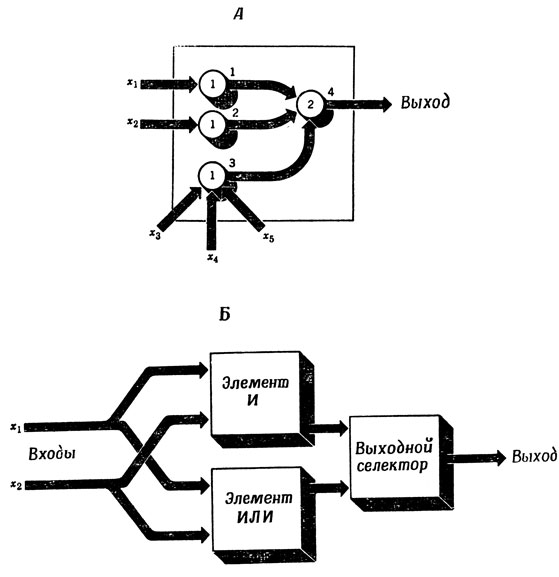

Рассмотрим простую схему, приведенную на рис. 1,А. Будем считать, что в каждый момент времени t по какой-то фиксированной шкале времени каждый из каналов, изображенных жирной стрелкой, может быть либо "возбужден", либо "не возбужден" и что выходной канал каждой ячейки, изображенной кружком с цифрой в середине (называемой "пороговым элементом" или "формальным нейроном"), возбуждается в момент времени t+1 только в том случае, если в момент времени t число его возбужденных входных каналов не меньше числа, указанного в кружке. В соответствии с этим нейроны 1 и 2 на рис. 1,А, имея пороговые значения, равные 1, выполняют лишь роль элемента задержки - характер сигнала на их выходе в точности повторяет характер сигнала на входе в предшествующий момент времени. Нейрон 3 возбуждает выходной сигнал в момент времени t+1, если по крайней мере один из каналов x3, x4 или x5 был возбужден в момент времени t. Наконец, нейрон 4 возбуждается, если в момент времени t были возбуждены по крайней мере два из его входных каналов. Поэтому, если все каналы x3, x4 и x5 бездействуют, выход всей схемы возбуждается в момент времени t+2 только в том случае, когда в момент t были возбуждены каналы хх и x2, а если в момент t был возбужден хотя бы один из каналов x3, x4 или x5, то возбуждение схемы в момент t+2 зависит от того, были ли возбуждены в момент t каналы x1 или x2 (или и тот и другой одновременно). Таким образом, сигналы, приходящие по каналам x3, x4 и x5, можно рассматривать как сигналы управления, определяющие, какую функцию должна выполнять наша схема по отношению к входам x1 и x2: элемента И или элемента ИЛИ.

Рис. 1. Иллюстрация утверждения о том, что две системы с одинаковыми функциями могут иметь совершенно различную внутреннюю структуру. A. Сеть из формальных нейронов. Нейроны 1 и 2 служат для передачи входной информации нейрону 4 после небольшой задержки. Характер комбинации этих входных сигналов, осуществляемой нейроном 4, зависит от характера управляющих переменных x3, x4 и x5, поступающих на вход нейрона 3. Если любой из этих управляющих каналов возбужден, то нейрон 4 действует как элемент ИЛИ; в противном случае этот нейрон ведет себя как элемент И. Таким Образом, эта 'нейронная схема' функционально эквивалентна схеме Б, в которой функции элементов ИЛИ и И выполняют пространственно разделенные подсистемы

Представим себе теперь, что x1 и x2 - входные каналы системы, но что, поскольку экспериментатор смотрит на эту систему извне, он ничего не знает о каналах x3, x4 и x5, приходящих, возможно, от других подсистем, которые его не интересуют. Тогда можно установить, что наша система может выполнять операцию И и операцию ИЛИ, но при этом на ее выходе должен иметься селектор, выбирающий, какой из результатов этих двух операций должен служить выходом системы. Это позволит нам в качестве резюме наших наблюдений за функционированием системы предложить схему ее устройства в виде, показанном на рис. 1,Б. Однако в нашей "реальной" системе (рис. 1,А) операции И и ИЛИ разделить нельзя!

Таким образом, даже если мы исчерпывающе изучили функционирование или поведение какой-либо системы, этого недостаточно, чтобы однозначно определить ее структуру. Поэтому наша теория мозга должна учесть данные анатомии и физиологии относительно внутреннего строения мозга, прежде чем она сможет объяснить какие-либо детали внутренних взаимодействий, обеспечивающих наблюдаемое поведение.

Следует добавить, что одно лишь отсутствие какой-то функции в данный момент еще не означает существования соответствующего специализированного участка мозга, который должен быть на это время отключен. Если бы один из управляющих каналов x3, x4 и x5 оказался поврежденным, это нарушило бы поведение системы в целом и она не выполняла бы операцию ИЛИ во многих случаях, когда бы это следовало. Или предположим, что в результате "заболевания" канал x3 будет находиться в состоянии постоянного возбуждения. Тогда нейрон 4 будет все время работать как элемент ИЛИ, а операция И вообще перестанет появляться в наших опытах. Таким образом, невозможность вызвать некоторую функцию еще не означает, что соответствующую сеть нейронов вообще нельзя возбудить, а лишь указывает на то, что мы не можем возбудить ее так, как нам надо. И можно представить себе мозг, в котором все нейроны возбуждены и все основные проводящие пути организованы правильно, но функции которого в результате ошибок в тонкой структуре или отклонения пороговых величин нарушены (ср., например, со случаем "центра торможения свиста", описанного в разд. 1.2). Читатель должен также понимать, что можно придумать такую нейронную сеть, в которой каждый нейрон участвует в реализации нескольких функций, но, кроме того, и сами эти функции распределены между несколькими анатомически обособленными областями сети.

В сущности в этом-то, по-видимому, и состоит хорошая стратегия обеспечения надежного функционирования мозга, построенного из нейронов, которые часто оказываются ненадежными.

Понять некоторые особенности функционирования, не зная ограничений, накладываемых на него реализующей его структурой, просто нельзя. Но в то же время нельзя разобраться в сложной структуре, не имея каких-то гипотез о ее глобальных функциях. Поэтому в теории мозга нельзя выдвигать на первый план ни функцию, ни структуру - исследования той и другой должны идти рука об руку.

|

ПОИСК:

|

© Злыгостев А.С., 2001-2019

При использовании материалов сайта активная ссылка обязательна:

http://informaticslib.ru/ 'Библиотека по информатике'

При использовании материалов сайта активная ссылка обязательна:

http://informaticslib.ru/ 'Библиотека по информатике'